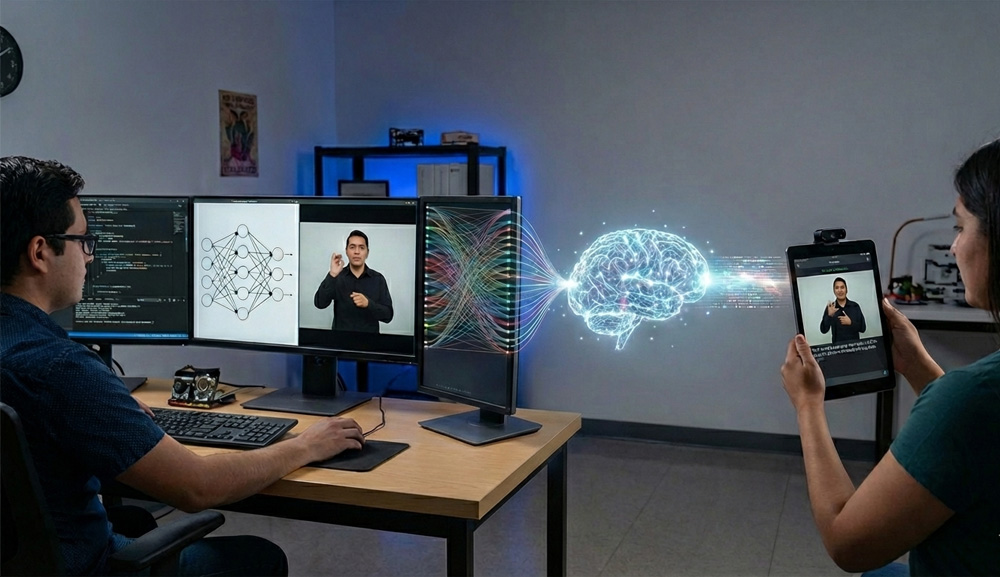

Redes neuronales abren posibilidad a la accesibilidad en salud por medio de la comprensión de lengua de señas en México

Liderazgo Anáhuac en Innovación

Liderazgo Anáhuac en Innovación

Investigadores de la Facultad de Ingeniería desarrollan un modelo basado en redes neuronales para interpretar la Lengua de Señas Mexicana en contextos clínicos y mejorar la accesibilidad en servicios de salud.

Recientemente, el alumno de Doctorado en Ingeniería Industrial el Mtro. Armando de Jesús Becerril-Carrillo en conjunto con dos profesores de la Facultad de Ingeniería, el Dr. Héctor Julián Selley Rojas y la Dra. Elizabeth Guevara Martínez, han dado un paso importante en el desarrollo de sistemas automatizados capaces de interpretar la Lengua de Señas Mexicana (LSM). En el contexto de servicios de salud, esta herramienta tiene el potencial de llegar a ser fundamental para permitir la comunicación entre personas con discapacidad auditiva con profesionales del sector salud cuando no hay acceso a intérpretes.

Un conjunto de datos orientados al aspecto clínico

Los investigadores trabajaron con un intérprete nativo de LSM y definieron un vocabulario de 150 palabras relacionadas a la atención médica en general. A partir del vocabulario, se grabaron videos de personas comunicando estas palabras a través de LSM y se generaron variantes sintéticas de cada video, implementando transformaciones de velocidad, rotación y efectos visuales para su creación. Cada uno fue procesado usando MediaPipe, una herramienta de visión por computadora encargada de extraer posiciones de articulaciones y manos, generando hasta 230 características por cuadro.

Estos videos forman parte del conjunto de datos de entrenamiento para el modelo construido. En el proceso de entrenamiento una red neuronal puede aprender patrones en los movimientos capturados por los videos, por ello es necesario contar con la mayor cantidad de variantes en los gestos de la LSM posible.

Precisión alta para signos aislados

Una vez entrenados con dichos datos, los modelos basados en LSTM y GRU (tipos de redes recurrentes diseñadas para secuencias) consiguieron alcanzar precisiones impresionantes cercanas al 99 % al reconocer signos individuales en pruebas controladas. Este hallazgo sugiere que las redes son capaces de distinguir de forma confiable los movimientos específicos de LSM cuando el contexto es limitado.

En pruebas adicionales, se evaluó cómo los modelos se enfrentaban a narrativas cortas, es decir, secuencias de signos sucesivos para formar frases simples, como si se contara un caso clínico, pero de forma hipotética, para este caso. Aquí, el rendimiento de los modelos cayó significativamente, llegando a un recall secuencial global del 45.45 %. Esto demuestra que la interpretación de la LSM mediante inteligencia artificial no es una tarea sencilla, es un proceso complejo que requiere una mejora continua. Este trabajo tiene un impacto alto debido a ello y con el antecedente de que no existen trabajos previos que hayan abordado este problema con un vocabulario tan amplio.

“La diferencia entre reconocer un signo aislado y comprender una cadena de signos como parte de un mensaje es grande. Los modelos tienden a confundirse cuando los movimientos se solapan o cambian rápidamente”, se explica en el artículo.

Comunicación es accesibilidad

La comunicación médica efectiva es fundamental para tratar a cualquier paciente, desafortunadamente, esta no siempre se cumple. Es muy común que las personas con discapacidad auditiva enfrenten numerosas barreras, entre las que destacan servicios de interpretación limitados y malentendidos en entornos clínicos. Por ello, el desarrollo de herramientas tecnológicas que puedan asistir en la traducción de señas a texto o voz podría convertirse en una pieza clave para mejorar la accesibilidad a la atención médica y garantizar que las personas que viven con esta discapacidad tengan un servicio de salud digno, lo que significa un impacto muy positivo en su vida.

Los autores exponen públicamente su código y los datos empleados, y con ello convierten este modelo en una pieza importante al ofrecer una plataforma abierta para que otros investigadores puedan avanzar en el desarrollo de estas herramientas y del crecimiento del vocabulario.

Los siguientes pasos

Los autores señalan que futuras investigaciones en la materia, deberán incluir datos de varias personas con distintos estilos en el uso de signos, así como realizar pruebas en entornos reales con ruido y variación propia del ambiente. Además, se requiere integrar el contexto lingüístico y la gramática de señas como factor crítico para asegurar que los sistemas no únicamente reconozcan patrones de movimiento, sino que puedan llegar a comprender un significado.

Por medio de este trabajo y al realizar más investigaciones interdisciplinarias, se enmarca el compromiso de la Universidad Anáhuac México por impulsar la innovación en soluciones tecnológicas para atender problemáticas sociales reales bajo los fundamentos de un liderazgo de acción positiva. Además, este trabajo busca beneficiar a un sector de la población vulnerable y generar un impacto importante en atención médica.

*Redacción: Francisco Iñaki Díaz Morales, alumno de octavo semestre de Ingeniería Biomédica y del Dr. Héctor Julian Selley Rojas de la Facultad de Ingeniería.

Más información:

Dr. Hector Julian Selley Rojas

hector.selley@anahuac.mx

Facultad de ingeniería